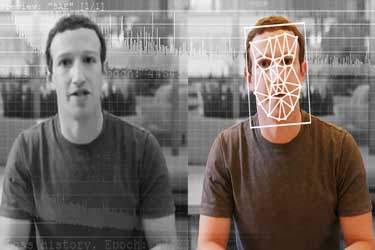

آرشيو برچسب: دیپ فیک

| صفحه بعد |

۶ مرداد ۱۴۰۳ ساعت ۰۳:۱۱

۱۷ تير ۱۴۰۳ ساعت ۰۹:۵۳

۹ تير ۱۴۰۳ ساعت ۱۲:۰۵

۲۸ خرداد ۱۴۰۳ ساعت ۰۰:۴۱

۲۴ خرداد ۱۴۰۳ ساعت ۰۴:۱۸

۱۶ خرداد ۱۴۰۳ ساعت ۰۴:۳۵

۲۳ ارديبهشت ۱۴۰۳ ساعت ۰۱:۰۱

۲۲ ارديبهشت ۱۴۰۳ ساعت ۰۵:۰۷

۱۹ ارديبهشت ۱۴۰۳ ساعت ۱۱:۰۳

۱۴ ارديبهشت ۱۴۰۳ ساعت ۰۵:۳۰

۲۵ فروردين ۱۴۰۳ ساعت ۰۶:۳۶

۲۱ فروردين ۱۴۰۳ ساعت ۰۱:۲۰

۲۰ فروردين ۱۴۰۳ ساعت ۰۲:۰۱

۸ فروردين ۱۴۰۳ ساعت ۰۶:۰۶

۲۶ اسفند ۱۴۰۲ ساعت ۰۰:۰۰

۱۷ اسفند ۱۴۰۲ ساعت ۰۶:۱۰

۷ اسفند ۱۴۰۲ ساعت ۱۴:۰۲

۴ اسفند ۱۴۰۲ ساعت ۱۶:۵۷

۲۷ بهمن ۱۴۰۲ ساعت ۰۲:۰۶

۲۵ بهمن ۱۴۰۲ ساعت ۱۰:۱۹

| صفحه بعد |